von Tommy Hasert und Gabriele Hooffacker

Abstract: Social Bots stehen im Verdacht, öffentliche Diskurse zu beeinflussen, Wahlentscheidungen zu manipulieren und auf politische Konflikte Einfluss zu nehmen. Dieser Beitrag beruht auf einer Untersuchung zum Erkennen und Bewerten von Social Bots in aktuellen Twitter-Debatten. Die Autoren zeigen, dass der Einfluss der Bots deutlich weniger dramatisch erscheint, als vielerorts zu lesen ist. Hingegen bestehe durch Überregulierung eine größere Gefahr für die Demokratie als durch die Bots selbst.

In partizipativen Plattformen mit nutzergenerierten Inhalten wie Twitter oder Facebook ist nicht immer auf Anhieb zu erkennen, ob ein Mensch interagiert oder ein sogenannter algorithmisch gesteuerter Account, der menschliche Aktivitäten imitiert, ein sogenannter Social Bot.

Den Bots wird großer Einfluss zugeschrieben. Die britische Tageszeitung The Guardian titelte: »Social media bots threaten democracy« (Woolley & Gorbis 2017). Die Washington Post warf im Rahmen einer Kolumne sogar die Frage auf, ob die amerikanische Demokratie derartige Eingriffe in den sozialen Medien überleben könne: »Artificial intelligence is transforming social media. Can American democracy survive?« (Watts 2018). »Social Bots« – eine Gefahr für die Demokratie«, schrieb Christian Kerl in der Berliner Morgenpost (Kerl 2017). Weitere deutsche Medien messen Social Bots großes destruktives Potential bei. So titelte Spiegel Online am 24.10.2016: »Social Bots – Wie digitale Dreckschleudern Meinung machen« (Amann et al. 2016). Weltpolitische Ereignisse wie beispielsweise der Brexit, der U.S.-Präsidentschaftswahlkampf 2016 oder der Russland-Ukraine-Konflikt sollen durch Social Bots beeinflusst worden sein.

Die gesellschaftliche und mediale Aufmerksamkeit führte zu politischen Forderungen nach einer stärkeren Regulation von Social Bots. Die Vorschläge reichten von einer einfachen Kennzeichnungspflicht (Die Grünen) bis hin zu einer generellen Klarnamenpflicht im Internet (CDU/CSU). Bots hätten das Potential, elementare Freiheiten aller Internetnutzer zu beschneiden (vgl. Reuter 2017, 2019).

Der mediale und politische Diskurs basiert jedoch nur zu einem geringen Teil auf empirisch belastbaren Zahlen. Daher untersucht dieser Beitrag, wie groß die Verbreitung von Social Bots auf Twitter (Facebook wurde nicht untersucht) ausfällt und welchen Einfluss ihre Aktivitäten haben.

Strategien der Bots

Wie nehmen Bots Einfluss auf soziale Akteure, Meinungen und Debatten? Drei Strategien lassen sich identifizieren:

Imitation

Das Imitieren menschlichen Verhaltens ist eine grundlegende Eigenschaft, die jeden Social Bot kennzeichnet. Dabei geht es primär darum, Vertrauen in die computergesteuerten Accounts zu schaffen durch das Vortäuschen einer menschlichen Identität. Dies wird dadurch erreicht, dass sich Social Bots in sozialen Netzwerken an menschlichen Verhaltensweisen orientieren. Am Beispiel von Twitter bedeutet es, sie tweeten und retweeten, sie folgen anderen Nutzern, sie partizipieren in Form von Replies an Diskussionen oder favorisieren fremde Inhalte (vgl. Misener 2011).

Auch die Sprache spielt eine wichtige Rolle. So sollen durch Verwenden natürlicher Sprachalgorithmen authentischere Antworten produziert werden (vgl. Good 2016). Absichtlich eingebaute Rechtschreibfehler und Slang-Sprache erschweren zudem die Enttarnung: »To avoid detection, they may even employ slang words, street idiom and socially accepted spelling mistakes.« (Woolley/Howard 2014).

Die Nutzung persuasiver Techniken scheint ebenfalls eine beliebte Methode zu sein, um das Vertrauen in die Bot-Accounts zu steigern. In Kenntnis des Social-Proof-Effekts ist es beispielsweise ratsam, zunächst möglichst viele Follower zu akquirieren, da diese als sozialer Beweis für die Relevanz dieses Accounts fungieren und damit seinen Einfluss steigern. Im Rahmen einer Studie von Hegelich und Janetzko konnte nachgewiesen werden, dass ein Großteil der verbreiteten Inhalte eines untersuchten Bot-Netzwerks keiner direkten Mission folgte, sondern lediglich der Schaffung von Vertrauen sowie der Aufrechterhaltung der Tarnung diente (vgl. Hegelich & Janetzko 2016). Auf der Basis dieses erarbeiteten Vertrauens/Einflusses könnten anschließend individuelle Ziele, wie beispielsweise das Werben für eine bestimmte politische Meinung oder das Diskreditieren einer öffentlichen Person, durchgesetzt werden.

Trends vortäuschen

Soziale Netzwerke fungieren immer häufiger als Trendbarometer für die Relevanz gesellschaftlicher Themen. Innerhalb des letzten Jahrzehnts ist eine ganze Industrie entstanden, die sich zur Aufgabe gemacht hat, Trends in den sozialen Medien zu identifizieren, um diese anschließend kommerziell zu verwerten. Aber auch Journalisten und Politiker nutzen die unterschiedlichen Social-Media-Kanäle, um ein Gefühl dafür zu bekommen »[…] wie Teile der Gesellschaft ticken« (Weck 2016). Social Bots profitieren von dieser gesellschaftlichen Relevanz und generieren durch die massive Nutzung bestimmter Hashtags oder Schlagworte eigene Trends, was zur Verzerrung der eigentlichen Bedeutung eines Themas führen kann (vgl. Meiselwitz 2017: 381).

Astroturfing

Der englische Begriff Astroturf (auch Kunstrasenbewegung) beschreibt die Strategie »[…] Partikularinteressen als vermeintliches Begehren von Bürgern zu organisieren […], mit dem Ziel gesellschaftspolitische Entscheidungen zu beeinflussen.« (Irmisch 2011: 24). Social Bots nutzen diesen Ansatz innerhalb öffentlicher Debatten, um den Eindruck zu erwecken, dass für bestimmte Meinungen oder Bewegungen große Zustimmungen vorlägen, obwohl dies gar nicht der Fall ist. Dies kann zur strategischen Verzerrung einer Debatte führen. Die strukturelle Beschaffenheit sozialer Netzwerke wie Twitter und Facebook, die das Teilen und Liken fremder Inhalte als Kernfunktion anbieten, liefern dafür ideale Voraussetzungen. Insbesondere in politischen Kontexten ist dies eine beliebte Strategie der Einflussnahme, die in unterschiedlichen Studien bereits mehrere Male nachgewiesen werden konnte (vgl. Ratkiewicz et al. 2011).

Smoke Screening

Smoke Screening (dt. Einnebelung) ist eine weitere Einflussstrategie, derer sich Social Bots bemächtigen. Dabei werden unliebsame Debatten gezielt durch eine massive Verbreitung von diskreditierenden oder irrelevanten Nachrichten gestört. Im Kontext von Twitter wird für dieses Vorgehen auch der Begriff »Twitter bombs« verwendet (vgl. Brachten et al. 2017), da einzelne Hashtags durch derartigen Spam unbenutzbar gemacht werden. Ein Beispiel für den Einsatz von Smoke Screening konnte von Abokhodair et al. in einer Studie rund um ein syrisches Bot-Netzwerk nachgewiesen werden (vgl. Abokhodair et al. 2015).

Wie entlarvt man Bots?

Neben Hürden wie Nutzerauthentifizierung und crowdbasierten Ansätzen (Meldesystem) setzen die großen sozialen Netzwerke vor allem auf Bot-Detektionsverfahren, um Social Bots und Fake-Inhalte von ihren Plattformen fernzuhalten. Twitter verschärfte dazu Mitte 2018 sein Vorgehen. Die Washington Post berichtete, dass allein im Mai und Juni 2018 mehr als 70 Millionen Accounts aufgrund verdächtigen Verhaltens gelöscht wurden (vgl. Timberg & Dwoskin 2018). Auch Facebook veröffentliche 2018 im Rahmen eines Transparenzberichtes erstmals Zahlen zu gelöschten Accounts. Demnach löschte Facebook in nur sechs Monaten mehr als eine Milliarde Accounts: »694 Millionen im letzten Quartal 2017 und 583 Millionen im ersten 2018« (Brühl 2018).

Die Identifizierung von Social Bots in den sozialen Netzwerken stellt die Forschung vor große Herausforderungen. Social Bots profitieren enorm davon, sich unauffällig zu verhalten und menschliches Verhalten möglichst exakt zu imitieren, um ihren Einfluss auszubauen. Teilweise wird ein Großteil der vorhandenen Ressourcen in die Verschleierung der Bot-Identität investiert. Eines der Kernprobleme besteht in der großen Diversität der eingesetzten Social Bots. Was aktuell zu der Situation führt, dass verschiedene Ansätze für verschiedene Arten von Social Bots unterschiedlich gut funktionieren. Erschwerend kommt hinzu, dass je nach Plattform und Privatsphäre-Einstellungen der Nutzer unterschiedliche Daten für eine Untersuchung zur Verfügung stehen: »[…] the majority of Twitter profiles are public, whilst on Facebook, most profiles are private« (Haugen 2017: 27). Zudem entwickeln sich Social Bots in Sachen Komplexität immer weiter. Dabei scheint es eine Art Wettrüsten mit der Forschung zu geben.

Für die vorliegende Untersuchung wurden zwei frei verfügbare automatisierte Verfahren zur Boterkennung benutzt, bevor die eigentliche inhaltliche Analyse ansetzte: Botometer und DeBot. Sie nutzen unterschiedliche Strategien:

Botometer (ursprünglich unter dem Namen BotOrNot veröffentlicht) ist ein Framework zur Erkennung von Bots auf Twitter, welches aus einer Zusammenarbeit zwischen dem Indiana University Network Science Institute (IUNI) und dem Center for Complex Networks and Systems Research (CNetS) hervorging. Das Framework nutzt zur Klassifikation mehr als 1000 Features aus Twitter-Metadaten, Inhalten und Interaktionsmustern (vgl. Davis et al. 2016). Die Features lassen sich in sechs Klassifikationsklassen unterteilen (vgl. Varol et al. 2017):

- Nutzer-basierte Features: Meta-Informationen wie z.B. Anzahl der Followings und Follower, Anzahl der verfassten Tweets sowie Profilbeschreibungen und Einstellungen

- Freundes-basierte Features: Basierend auf den vier Typen des Informationsaustausch (retweeten, erwähnen, retweetet werden und erwähnt werden) werden verschiedene sprachliche (z.B. Entropie der Sprache, Anzahl der verwendeten Sprachen) und zeitliche Aspekte (z.B. Alter des Accounts) betrachtet, aber auch die Popularität des Tweets sowie die Zeit zwischen zwei veröffentlichten Tweets.

- Netzwerk-basierte Features wie Retweet-Netzwerk, User-Mention-Netzwerk und Hashtag (Koexistenz)-Netzwerk

- Temporale Features: Basierend auf der Messung der Aktivität in bestimmten Zeitintervallen wird die durchschnittliche Tweetproduktion sowie Retweet- und User Mention Rate betrachtet.

- Inhalts- und Sprach-basierte Features durch statistische Erhebungen der Länge und Informationsdichte von Tweets

- Sentiment-basierte Features: Auskunft über die Emotionen, die durch einen Text vermittelt werden.

Ein völlig anderer Ansatz zur Bot-Erkennung wurde im Jahr 2016 von einem dreiköpfigen Forscherteam der University of New Mexico unter dem Namen DeBot entwickelt. Dieser eignet sich vor allem für das Erkennen von Bots, die einem Botnetz angehören, denn DeBot kommt völlig ohne die Analyse expliziter Metadaten von Nutzern aus. Stattdessen werden Aktivitätsverläufe betrachtet und diese auf Korrelationen abgeglichen, denn die zugrundeliegende Prämisse des Forscherteams lautet: »[…] humans cannot be highly synchronous for a long duration; thus, highly synchronous user accounts are most likely bots« (Chavoshi et al. 2016). Das Besondere an der Methode ist die Tatsache, dass selbst zeitlich verzögerte, aber dennoch synchrone Aktivitätsverläufe erfasst werden können.

Untersuchungsdesign

In der Untersuchung wurde eine Kombination aus technischen Detektionsverfahren und einer inhaltlichen, ebenfalls auf Algorithmen basierenden Analyse der von Social Bots und Menschen produzierten Inhalte vorgenommen, um daraus mögliche Motive für den Bot-Einsatz zu schlussfolgern. Folgende Forschungsfragen bildeten das Fundament der Untersuchung:

- Wie hoch ist die Quote von Social Bots und welchen Gesamtanteil nehmen deren Inhalte in den untersuchten Datensätzen ein?

- Hat die inhaltliche Ausrichtung des Datensatzes (Politik, Gesellschaft, Konsum, Lifestyle) einen signifikanten Einfluss auf die Social Bot-Quote?

- Wie groß ist die Reichweite der gefundenen Bot-Accounts und welchen Einfluss haben die von Social Bots verbreiteten Tweets?

- Unterscheiden sich die von Social Bots verbreiteten Inhalte von menschlichen Inhalten in Bezug auf Text-Länge, Text-Stimmung, Text-Subjektivität, verbreitete Medien (Bilder, Videos, Links) sowie eingesetzte Verlinkungsstrategien (Hashtags, Cashtags, User Mentions)?

Bei den zu untersuchenden Daten handelt es sich um Tweets, die über einen festgelegten Untersuchungszeitraum von zehn Tagen mittels einer Auswahl von Hashtags verschlagwortet wurden. Jedes Hashtag repräsentiert eine Debatte bzw. einen Informationsaustausch mit unterschiedlicher thematischer Ausrichtung. Alle zu einem Hashtag extrahierten Tweets werden als eigenständige Datensätze analysiert und die Ergebnisse am Ende der Untersuchung verglichen. Da Twitter selbst identifizierte Bots löscht, konnten nur veröffentlichte Tweets untersucht werden.

Die Datenbasis

Als Untersuchungszeitraum wurde der 1. August 2018 bis einschließlich 10. August 2018 festgelegt. Die Zeitspanne von zehn Tagen beruhte auf einer ungefähren Abschätzung der erwartbaren Menge an Tweets, basierend auf den zugrunde gelegten Forschungsparametern.

Die Hashtags und die damit verbundene thematische Ausrichtung der untersuchten Inhalte wurden nach den folgenden Kriterien ausgewählt:

- Die Anzahl der Tweets im gewählten Zeitraum muss ausreichend groß sein (mind. 10.000), darf jedoch in Summe die Anzahl von 250.000 Tweets nicht überschreiten (aufgrund existierender Twitter-API Limitationen).

- Die zu untersuchenden Tweets sollen unterschiedliche inhaltliche Bereiche repräsentieren (Politik, Gesellschaft, Konsum, Lifestyle), damit möglichst viele potentielle Interessen für den Einsatz von Social Bots abgedeckt werden, z.B. Beeinflussung politischer Meinungsbildung sowie Diffamierung politischer Gegner, Beeinflussung des gesellschaftlichen Diskurses, Verschiebung kommerzieller Interessen, usw.

- Die Tweets müssen, aufgrund der geplanten Sentimentanalyse, in einer einheitlichen Sprache vorliegen. Basierend auf der höheren Tweet-Anzahl zu einzelnen Debatten und der besseren Kompatibilität zu entsprechenden Frameworks wird dies Englisch sein, d.h. es sollten nur internationale und/oder nationale Hashtags für einen englischen Sprachraum gewählt werden.

Nach eingehender Recherche unterschiedlicher Hashtags haben sich die folgenden vier als geeignet herausgestellt:

#midTerms2018: Das Hashtag bezieht sich auf die am 6. November 2018 abgehaltenen Zwischenwahlen in den USA. Dabei wurden sowohl das Repräsentantenhaus als auch ein Drittel des Senats neu gewählt. Die Wahlen gelten zudem als nationales Stimmungsbarometer für die kommenden Präsidentschaftswahlen. Das Hashtag umfasst politische Diskussionen, Hinweise auf mediale Berichterstattungen sowie Wahlprognosen. Aufgrund der zeitlichen Nähe zu den Zwischenwahlen war das Hashtag zudem gut frequentiert.

#metoo: Mitte Oktober 2017, kurz nach dem Bekanntwerden mehrerer Anschuldigungen gegen den Produzenten Harvey Weinstein, der des sexuellen Missbrauchs sowie der sexuellen Nötigung mehrerer Frauen innerhalb der Filmbranche beschuldigt wurde, startete Tarana Burke eine Aktion, die darauf ausgerichtet ist, sexuelle Übergriffe und Belästigung öffentlich sichtbar zu machen (vgl. Göbel & Bäuerlein 2017). Diese Aktion und die damit einhergehende Debatte findet seitdem unter dem Hashtag #metoo statt – welches als Synonym für die gleichnamige MeToo-Bewegung fungiert. Das Hashtag hat seit seiner Etablierung nichts an Brisanz verloren, was es für die geplante Analyse zu einem idealen Ausgangspunkt macht.

#iphone: Das Hashtag #iphone repräsentiert in der vorliegenden Auswahl überwiegend Inhalte kommerzieller bzw. konsumorientierter Natur und soll damit einen anderen Schwerpunkt als die zuvor genannten Hashtags setzen. Aufgrund der zeitlich nahestehenden Veröffentlichung eines neuen IPhone-Modells (IPhone XS) am 14.9.2018 war das Hashtag im gewählten Zeitraum aufgrund diverser Spekulationen und Werbung besonders häufig in Benutzung.

#foodporn: Mit dem Hashtag #foodporn soll ein ganz eigener Trend der letzten Jahre aufgegriffen werden – die (ästhetische) Darstellung von Nahrungsmitteln in sozialen Medien. Zwar tangiert auch dieses Hashtag den Themenbereich Konsum, zielt aber im Kern deutlich mehr auf den Bereich Lifestyle ab und stellt damit eine thematische Ergänzung zu vorangegangen Hashtags dar.

Technischer Ablauf

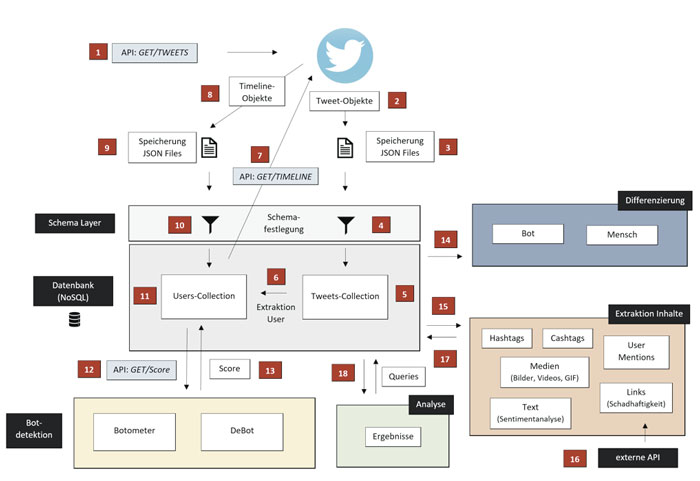

Der technische Ablauf der Untersuchung ist in dieser Abbildung schematisch dargestellt. Für jeden zu untersuchenden Datensatz (#midTerms2018, #metoo, #iphone und #foodporn) müssen die Schritte 1-16 separat wiederholt werden, um am Ende vergleichbare Ergebnisse erzielen zu können.

Abbildung 1

Schritte der Untersuchung

Ergebnis: Weniger Bots, weniger Einfluss als vermutet

Social Bots schnitten überall schlechter ab als Menschen: Sie hatten im Durchschnitt ca. 33 Prozent weniger Follower, 63 Prozent weniger Likes, 49 Prozent weniger Retweets und 67 Prozent weniger Replies. Zudem wurden inhaltliche Vergleiche bezugnehmend auf die eingesetzten Verlinkungsstrategien, Einbindung von Medien sowie externen Links und Textcharakteristiken (Sentiment-

analyse) angestellt. Die daraus resultierenden Ergebnisse lassen zwar Unterschiede erkennen – Social Bots nutzen ca. 50 Prozent mehr Hashtags, 22 Prozent mehr externe Links, 20 Prozent mehr Medien und verbreiten um ca. 30 Prozent kürzere Texte mit einer leicht negativeren und objektiveren Charakteristik. Eine gezielte Einflussstrategie konnte jedoch nicht festgestellt werden.

Ein Großteil der bisherigen Forschung konzentrierte sich ausschließlich auf politische Debatten. Die Ergebnisse dieser Arbeit legen jedoch nahe, auch Inhalte mit kommerziellem Hintergrund in die Untersuchung einzubeziehen, um einen umfassenderen Blick auf das Thema Social Bots zu erhalten.

1. Wie hoch ist die Quote von Social Bots und welchen Gesamtanteil nehmen deren Inhalte in den untersuchten Datensätzen ein?

Insgesamt konnten 9.644 von 125.610 untersuchten Accounts als Social Bots identifiziert werden, was einer Quote von 7,68 Prozent entspricht. Mit Blick auf die unterschiedlichen Datensätze offenbaren sich jedoch große Unterschiede dieser Quote je nach thematischem Schwerpunkt.

2. Hat die inhaltliche Ausrichtung des Datensatzes (Politik, Gesellschaft, Konsum, Lifestyle) einen signifikanten Einfluss auf die Social-Bot-Quote?

Die geringste Social-Bot-Quote von 4,53 Prozent wurde ausgerechnet in der politischen Debatte #midTerms2018 festgestellt. Die #metoo-Diskussion als Repräsentant einer gesellschaftlichen Debatte wies eine ähnlich niedrige Social-Bot-Quote von 6,60 Prozent auf. Lifestyle- und Konsuminhalte scheinen hingegen deutlich attraktiver für den Einsatz von Social Bots zu sein. In den Datensätzen #foodporn konnten 10,91 Prozent und in #iphone 17,79 Prozent der Accounts als Social-Bot-Accounts identifiziert werden.

3. Wie groß ist die Reichweite der gefundenen Bot-Accounts und welchen Einfluss haben die von Social Bots verbreiteten Tweets?

Gleichzeitig wurde im Rahmen der Untersuchung festgestellt, dass Social Bots vergleichsweise produktiv waren. 13,18 Prozent der insgesamt 207.687 untersuchten Tweets stammten von Social Bots. Diese produzierten damit fast doppelt so viele Tweets pro Account wie Menschen, allerdings mit einem geringeren Einflusspotential. Social Bots wiesen im Durchschnitt ca. 33 Prozent weniger Follower auf. Inhalte von Menschen hatten zudem ca. zweieinhalb Mal so viele Likes, doppelt so viele Retweets und dreimal so viele Replies im Vergleich zu Inhalten von Social Bots. Einzig im Datensatz #midTerms2018 konnten Social Bots eine um ca. 75 Prozent größere Reichweite vorweisen.

4. Unterscheiden sich die von Social Bots verbreiteten Inhalte von menschlichen Inhalten in Bezug auf Text-Länge, Text-Stimmung, Text-Subjektivität, verbreitete Medien (Bilder, Videos, Links) sowie eingesetzte Verlinkungsstrategien (Hashtags, Cashtags, User Mentions)?

Der bevorzugte Verlinkungsmechanismus von Social Bots sind Hashtags. Diese werden von Social Bots ca. 50 Prozent häufiger und in einer größeren Varianz eingesetzt. User Mentions, als Möglichkeit der direkten Nutzeradressierung, wurden hingegen von Menschen präferiert und kamen bei diesen mehr als doppelt so häufig zum Einsatz.

Eine weitere Erkenntnis betrifft den Einsatz externer Links. Diese wurden – wie auch bereits in den Studien von Stieglitz et al. 2017, Gilani et al. 2017, Brachten et al. 2017 und Chu et al. 2010 festgestellt wurde – häufiger von Social Bots eingesetzt (um ca. 22 Prozent). Der Anteil schadhafter Links fiel zwar bei Social Bots etwas höher aus, war aber insgesamt sehr gering: 1,86 Prozent bei Social Bots und 0,46 Prozent bei Menschen.

Analog zur Linkquote fiel auch der Medienanteil bei Social Bots um ca. 20 Prozent höher aus. Diese verwendeten im Durchschnitt 0,55 Medien pro Tweet, Menschen hingegen nur 0,45 Medien pro Tweet. Bei der Verteilung der Medien (Bild, Video, GIF) konnte keine größere Abweichung zwischen Menschen und Social Bots festgestellt werden: Das mit Abstand beliebteste Medium war in beiden Gruppen das Bild.

Konträr zur größeren Link- und Medienquote fielen die Texte bei Social Bots um ca. 30 Prozent kürzer aus als bei Menschen. Die Sentimentanalyse der Texte lieferte keine grundlegend abweichenden Ergebnisse. Die Grundstimmung lag im leicht positiven Bereich. Tweets von Menschen wiesen bei einem Wertebereich von -1/+1 einen Wert von +0,21 (μ: 0,29) auf und Social Bots einen Wert von +0,14 (μ: 0,28). Einzig im Datensatz #midTerms2018 konnten bei Social Bots negativere Texte im Vergleich zu Texten von Menschen festgestellt werden. Hier scheint ein Indiz für eine negative Einflussstrategie vorzuliegen.

Der Vergleich der Inhalte offenbart zwar Unterschiede zwischen Social Bots und Menschen. Diese fallen jedoch nicht gravierend aus und lassen keine explizite Strategie erkennen. Die inhärente Taktik von Social Bots, möglichst authentisch menschlich zu kommunizieren, scheint zumindest formal aufgegangen zu sein. Der geringere Einfluss einzelner Tweets in Kombination mit der größeren Tweetproduktion lassen darauf schließen, dass Social Bots ihren Fokus stärker auf Quantität statt Qualität setzten. Auch die geringere Reichweite (33 Prozent weniger Follower) kann als Indiz für einen geringeren Einfluss gewertet werden.

Die Ergebnisse dieser Arbeit stehen damit im deutlichen Kontrast zur medialen Berichterstattung. Social Bots haben nach aktuellem Forschungsstand keinen übermäßig großen Einfluss und sind auch nicht überproportional in den sozialen Netzwerken vertreten. Ebenso fragwürdig, weil bis dato unerforscht, erscheint die tatsächliche Wirkung der von Social Bots verbreiteten Inhalte auf die Meinungsbildung bzw. auf das Offline-Verhalten von Nutzern.

Was die Medien daraus lernen könnten

Die Vermutung liegt nahe, dass es sich um ein Agenda-Setting der Medien handelt. Über die Ursachen kann nur spekuliert werden. Liegen sie in der Verunsicherung der Medienschaffenden, in der Unwissenheit, Algorithmen betreffend? Sind es journalistische Prozesse der Nachrichtenauswahl – weil die einen davor warnen, greifen es andere auf? Sind es wirtschaftliche Gründe, warum das Gefahrenpotential von Social Bots so hochstilisiert wird?

Theoretische Gefahren und Risiken, die von Social Bots ausgehen, wie etwa die manipulative Beeinflussung von Kaufentscheidungen sowie gesellschaftlichen Diskursen bis hin zur Beeinflussung von Wahlentscheidungen, sind sicherlich vorstellbar. Es existieren jedoch nach aktuellen Erkenntnissen keine eindeutigen Belege für deren Wirksamkeit. Einige Autoren sprechen sogar von einer »Mär von ›Social Bots‹« (Gallwitz/Krell 2019).

Vielmehr besteht durch eine einseitige Berichterstattung die Gefahr einer verzerrten Wahrnehmung von Social Bots, welche unter Umständen zu restriktiven politischen Konsequenzen, wie beispielsweise einer stärkeren Regulierung von sozialen Netzwerken führen kann. Diese Ansicht vertritt auch Linus Neumann, Sprecher des Chaos Computer Clubs. Er sieht in Social Bots eher ein Symptom als eine Ursache für aktuelle gesellschaftliche Entwicklungen (vgl. Kind et al. 2017: 57). Das Einflusspotential liege hingegen bei ganz anderen Akteuren: »Privatfernsehen, Bild-Zeitung und lügende Innenminister würden die Menschen viel eher politisch beeinflussen« (Rebiger 2017).

Für die mediale Berichterstattung bleibt festzuhalten: Sie sollte »den bewussten Umgang mit den Kanälen und Diskursen fördern«, denn »Auch Algorithmen machen Fehler« (Niekler 2019). Während die einen vor der Macht der Social Bots warnen und eine europaweite Regulierung fordern (Sarovic 2019), sehen andere die Gefahr eher in einer Verschärfung der Gesetze. Dass die Gefahr der Überregulierung eine wesentlich höhere Gefahr für die Demokratie darstellt als die Bedrohung durch Bots, hält auch Markus Reuter fest: »Das Problem bei der Bekämpfung von Social Bots oder anderen manipulativen Accounts ist, dass eine Regulierung sehr schnell Grundrechte wie die Presse- oder Meinungsfreiheit tangiert – und so die negativen Folgen der Regulierung schwerer wiegen als der derzeit (kaum) festgestellte Schaden für die Demokratien durch diese Taktiken der Desinformation.« (Reuter 2019)

Der Beitrag basiert auf einer Masterarbeit im Fach Medieninformatik an der Hochschule für Technik, Wirtschaft und Kultur (HTWK) Leipzig von Tommy Hasert.

Über die Autoren

Tommy Hasert (*1988) hat seinen Master of Science in Medieninformatik an der Hochschule für Technik, Wirtschaft und Kultur (HTWK) Leipzig erworben. Er arbeitet als Programmierer in Leipzig. Kontakt: t.hasert@posteo.de

Gabriele Hooffacker (*1959), Dr. phil., lehrt als Professorin an der Fakultät Informatik und Medien der HTWK Leipzig. Sie ist Mitherausgeberin der Journalistik. Kontakt: g.hooffacker@link-m.de

Literatur

Abokhodair, Norah; Yoo, Daisy; McDonald, David W. (2015): Dissecting a Social Botnet. In: Dan Cosley, Andrea Forte, Luigina Ciolfi und David McDonald (Hrsg.): Proceedings of the 18th ACM Conference on Computer Supported Cooperative Work & Social Computing – CSCW‚ 15. the 18th ACM Conference. Vancouver, BC, Canada, 14.03.2015 – 18.03.2015. New York, USA: ACM Press, S. 839–851

Amann, Melanie; Knaup, Horand; Müller, Ann-Katrin; Rosenbach, Marcel; Wiedmann-Schmidt, Wolf (2016): Social Bots. Wie digitale Dreckschleudern Meinung machen. In: Spiegel Online. Online verfügbar unter http://www.spiegel.de/spiegel/social-bots-propaganda-roboter-verzerrenpolitische-diskussion-im-netz-a-1117955.html#ref=rss, zuletzt aktualisiert am 24.10.2016 (10.12.2018)

Brachten, Florian; Stieglitz, Stefan; Hofeditz, Lennart; Kloppenborg, Katharina; Reimann, Annette (2017): Strategies and Influence of Social Bots in a 2017 German state election – A case study on Twitter. ArXiv, abs/1710.07562.

Brühl, Jannis (2018): Das große Scannen. Facebook. In: Süddeutsche Zeitung Online. Online verfügbar unter https://www.sueddeutsche.de/wirtschaft/Facebook-das-grosse-scannen- 1.3982384, zuletzt aktualisiert am 16.05.2018 (13.11.2018)

Davis, Clayton; Onur Varol; Emilio Ferrara; Alessandro Flammini; Filippo Menczer (2016): BotOrNot: A System to Evaluate Social Bots. In: Proceedings of the 25th International Conference on World Wide Web Companion, S. 273-274. https://doi.org/10.1145/2872518.2889302

Gallwitz, Florian; Krell, Michael: Die Mär von »Social Bots«. In: Tagesspiegel, 03.06.2019, zuletzt aktualisiert 05.06.2019, online verfügbar unter https://background.tagesspiegel.de/die-maer-von-social-bots (07.06.2019)

Hasert, Tommy (2018): Einfluss von Social Bots in sozialen Netzwerken am Beispiel von Twitter. Unveröffentlichte Masterarbeit, Studiengang Medieninformatik, HTWK Leipzig.

Haugen, Geir Marius Sætenes (2017): Manipulation and Deception with Social Bots: Strategies and Indicators for Minimizing Impact. Master Thesis. Norwegian University of Science and Technology

Hegelich, Simon; Janetzko, Dietmar (2016): Are Social Bots on Twitter Political Actors? Empirical Evidence from a Ukrainian Social Botnet. In: Proceedings of the Tenth International AAAI Conference on Web and Social Media (ICWSM 2016), S. 579-582

Irmisch, Anna (2011): Astroturf. Eine neue Lobbyingstrategie in Deutschland? Wiesbaden: VS Verlag für Sozialwissenschaften. Online verfügbar unter http://dx.doi.org/10.1007/978-3-531-92890-6

Kerl, Christian (2017): »Social Bots« – eine Gefahr für die Demokratie. In: Berliner Morgenpost, 21.1.2017. Online verfügbar unter https://www.morgenpost.de/politik/article209348349/Social-Bots-eine-Gefahr-fuer-die-Demokratie.html (1.6.2019)

Kind, Sonja; Bovenschulte, Marc; Ehrenberg-Silies, Simone; Jetzke Tobias; Weide Sebastian (2017): Social Bots. TA-Vorstudie. Hrsg. v. VDI/VDE Innovation + Technik GmbH. Büro für Technikfolgen-Abschätzung beim Deutschen Bundestag

Meiselwitz, Gabriele (Hrsg.) (2017): Social Computing and Social Media. Human Behavior. 9th International Conference, SCSM 2017, Held as Part of HCI International 2017, Vancouver, BC, Canada, July 9-14, 2017, Proceedings, Part I

Misener, Dan (2011): Rise of the socialbots: They could be influencing you online. CBC News. Online verfügbar unter https://www.cbc.ca/news/technology/rise-of-the-socialbots-they-could-beinfluencing-you-online-1.981796 (05.11.2018)

Niekler, Andreas (2019): »Auch Algorithmen machen Fehler«. Online verfügbar unter https://www.mediaqualitywatch.de/nachrichten/quot-auch-algorithmen-machen-fehler-quot (07.06.2019)

Ratkiewicz, J.; Conover, M. D.; Meiss, M.; Goncalves, B.; Flammini, A.; Menczer,F. (2011): Detecting and Tracking Political Abuse in Social Media. In: Proceedings of the Fifth International AAAI Conference on Weblogs and Social Media, S. 279-304

Rebiger, Simon (2017): Fachgespräch im Bundestag: Experten halten Einfluss von Social Bots für überschätzt. netzpolitik.org. Online verfügbar unter https://netzpolitik.org/2017/fachgespraech-im-bundestag-experten-halteneinfluss-von-social-bots-fuer-ueberschaetzt/, zuletzt aktualisiert am 02.02.2017 (12.12.2018)

Reuter, Markus (2019): Social Bots: Was nicht erkannt werden kann, sollte nicht reguliert werden. In: netzpolitik.org. Online verfügbar unter https://netzpolitik.org/2019/social-bots-was-nicht-erkannt-werden-kann-sollte-nicht-reguliert-werden/, zuletzt aktualisiert am 9.5.2019 (1.6.2019)

Reuter, Markus (2017): Regulierungsdauerfeuer gegen Fake News und Social Bots ohne empirische Grundlage. In: netzpolitik.org. Online verfügbar unter https://netzpolitik.org/2017/regulierungsdauerfeuer-gegen-fake-news-und-socialbots-ohne-empirische-grundlage/, zuletzt aktualisiert am 24.01.2017 (10.12.2018)

Sarovic, Alexander (2019): »Eine echte Bedrohung für die Demokratie«. In: Spiegel online. Online verfügbar unter https://www.spiegel.de/politik/ausland/europawahl-2019-anne-applebaum-ueber-fake-news-und-desinformationskampagnen-a-1267521.html, 23.5.2019 (1.6.2019)

Timberg, Craig; Dwoskin, Elizabeth (2018): Twitter is sweeping out fake accounts like never before, putting user growth at risk. In: Washington Post. Online verfügbar unter https://www.washingtonpost.com/technology/2018/07/06/Twitter-is-sweepingout-fake-accounts-like-never-before-putting-user-growthrisk/?utm_term=.a5f08e55c2ea, zuletzt aktualisiert am 06.07.2018 (13.11.2018)

Varol, Onur; Ferrara, Emilio; Davis, Clayton A.; Menczer, Filippo; Flammini, Alessandro (2017): Online Human-Bot Interactions. Detection, Estimation, and Characterization. In: Proceedings of the Eleventh International AAAI Conference on Web and Social Media (ICWSM 2017), S. 280-289

Watts, Clint (2018): Artificial intelligence is transforming social media. Can American democracy survive? In: The Washington Post. Online verfügbar unter https://www.washingtonpost.com/news/democracypost/wp/2018/09/05/artificial-intelligence-is-transforming-social-media-canamerican-democracy-survive/?utm_term=.dfb1169f9c8e, zuletzt aktualisiert am 05.09.2018 (10.12.2018)

Weck, Andreas (2016): Wie Social-Media-Trends durch Bots manipuliert werden. In: t3n. Online verfügbar unter https://t3n.de/news/social-media-trendsbots-694529/ (06.11.2018)

Woolley, Samuel; Gorbis, Marina (2017): Social media bots threaten democracy. But we are not helpless. In: The Guardian. Online verfügbar unter https://www.theguardian.com/commentisfree/2017/oct/16/bots-social-mediathreaten-democracy-technology, zuletzt aktualisiert am 16.10.2017 (10.12.2018)

Woolley, Sam; Howard, Phil (2014): Bad News Bots: How Civil Society Can Combat Automated Online Propaganda. Online verfügbar unter http://techpresident.com/news/25374/bad-news-bots-how-civil-society-cancombat-automated-online-propaganda (05.11.2018)

Über diesen Artikel

Copyright

Dieser Artikel wird unter der Creative Commons Namensnennung 4.0 International Lizenz (http://creativecommons.org/licenses/by/4.0/deed.de) veröffentlicht, welche die Nutzung, Vervielfältigung, Bearbeitung, Verbreitung und Wiedergabe in jeglichem Medium und Format erlaubt, sofern Sie den/die ursprünglichen Autor(en) und die Quelle ordnungsgemäß nennen, einen Link zur Creative Commons Lizenz beifügen und angeben, ob Änderungen vorgenommen wurden.

Zitationsvorschlag

Tommy Hasert; Gabriele Hooffacker: Überschätzte Bots? Eine Untersuchung von Twitter-Debatten – und was Redaktionen daraus lernen können. In: Journalistik, 2, 2019, 2. Jg., S. 140-153. DOI: 10.1453/2569-152X-22019-9856-de

ISSN

2569-152X

DOI

https://doi.org/10.1453/2569-152X-22019-9856-de

Erste Online-Veröffentlichung

Oktober 2019